Facebook se čisti

Da je Facebook potrebe temeljite prevetritve, je jasno tudi njemu. In očitno tudi dela na tem. Do sedaj je ukinil kar 583 milijonov lažnih računov.

V svoji strategiji je Zuckerbergova ekipa boju proti neželenim vsebinam razdelila v šest kategorij – nazorno nasilje, odrasla golota in spolne aktivnosti, teroristična propaganda, sovražni govor, spam, in lažni računi. V poročilu, ki so ga izdali sedaj, sledilo pa bo novo vsake tri mesece, so navedli količino omenjene vsebine, ki so jo prijavili uporabniki, kolikšen del te so odstranili in koliko so je odstranili še preden so dobili prijavo s strani uporabnikov.

Po pričakovanjih je so najbolj problematična neželena oglasna sporočila (spam). V prvem četrtletju jih je Facebook odstranil kar 837 milijonov. Številka je sicer velika, a ne hudo presenetljiva. Bolj presenetljivo je število lažnih računov. Teh naj bi v prvem četrtletju odstranili kar 583 milijonov. Sicer je res, da pri Facebooku ni majhnih številk, a da so te tako velike, si nismo mislili. Poleg omenjenega so odstranili še 21 milijonov objav, povezanih z eksplicitno goloto in/ali seksualno vsebino, 3,5 milijona objav z nasilno vsebino, 2,5 milijona objav s sovražnim govorom, in 1,9 milijona objav s teroristično vsebino.

Pri odkrivanju omenjenih vsebin jim v veliki meri pomaga tehnologija. Pravijo, da ta samodejno odkrije skoraj 100 odstotkov spama in terorističnih vsebin, 99 odstotkov lažnih računov, 96 odstotkov golote in seksa ter 86 odstotkov objav z nasilno vsebino. Največja težava je seveda sovražni govor, kjer je samodejne zaznave le okoli 38 odstotkov, tako da na Facebook na tem področju čaka še veliko dela. In prav zato baje veliko vlagajo v sisteme umetne inteligence. A dokler ti ne bodo sposobni odkriti spodobnega odstotka, bodo delo morali »ročno« opravljati zaposleni.

Vse skupaj se sliši zelo obetavno, a je rezultate vsaj delo potrebno jemati z rezervo. Facebook namreč ne navaja, koliko najdene vsebine je bilo neupravičeno označeno kot neželeno oziroma koliko uporabnikom so morali vsebino spet aktivirati. Poleg tega bodo morali nekaj narediti tudi na komunikaciji z uporabniki glede tovrstne vsebine. Pri prijavi neželene vsebine recimo ni mogoče povedati, zakaj je ta neprimerna. To je recimo dokaj nazorno pri uporabnikih, ki, tako kot mi, govorijo manj zastopan jezik. Če nekdo pri nas recimo sproži sovražni govor, Facebook tega ne bo zaznal, prijavitelj pa tudi nima možnosti, da bi mu to razložili. Druga težava je, ker so sporočila o umaknjeni vsebini zelo skopa in uporabnik pogosto ne ve, zakaj je bila umaknjena. A dajmo jim še nekaj časa. Zadnji meseci so jih precej streznili in to je šele prvo poročilo.

Vir: Facebook

preberite še to

Stolpi namesto dreves?

Stolp, ki čisti zrak kot 368 dreves…

Gozdni internet

A veste, da imajo tudi drevesa v gozdu svoj »internet«. Koreninski sistemi dreves se med seboj &ra...

Ne gre in ne gre…

Ali imate tudi vi kakšno besedo, ki vam nikakor ne gre z jezika…

Moški in ženski jezik

Pravijo, da so ženske z Venere, moški pa z Marsa… in pri skupnosti Ubang je to več kot očitno&he...

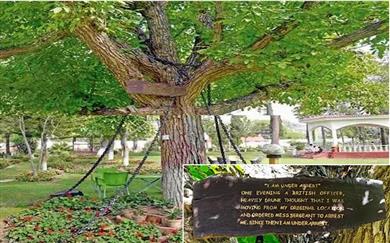

Najstarejši zapornik na svetu

Ni v zaporu ampak je že od leta 1899 priklenjen v - parku

Prespal je cilj

Pilot je med letom zaspal in zgrešil cilj za dobrih 45 kilometrov.

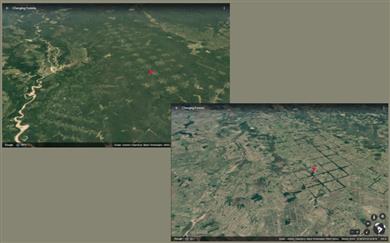

Kaj počnemo z Zemljo?

Google Earth že nekaj časa ponuja funkcijo časovnega sprehoda skoti zgodovino posameznih področij

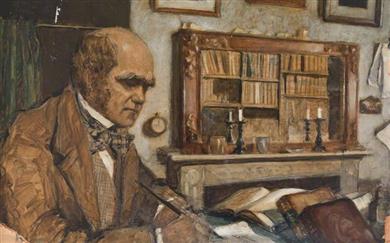

Oglejte si osebno knjižnico Charlesa Darwina

Na spletu je bila pred kratkim objavljena celotna vsebina osebne knjižnice naravoslovca Charlesa Darwina,...

Nad plastiko z mutiranim encimom

Bakterijski encim iz komposta bi lahko pomagal k hitrejši in učinkovitejši reciklaži plastenk.

»Izgini, ti pravim!«

Tako pa je videti najbolj jezna želva na svetu…

Uporabimo uporabljeno in namestitev morske oaze v Piranskem zalivu

Promocijska vsebina

Na svetovni dan...

Kontejnerski bazen

Zakaj bi bazen vkopavali, če pa ga lahko spravimo v kontejner…

Priporočamo še

TOP 5 meseca

-

Tri z enim ugrizom

En sam klop je nesrečnemu sedemdesetletniku prenesel kar tri bolezni hkrati.

-

Kontejnerski bazen

Zakaj bi bazen vkopavali, če pa ga lahko spravimo v kontejner…

-

Strešni šotor

Zakaj na taborjenju ne bi spali kar na strehi avtomobila?

-

Zakaj pa to leti?

Ali lahko helikopter leti brez vrtenja elise? Tale očitno lahko. Ali pa tudi ne…

-

Niso bili veliki le dinozavri

V triasu, torej dobrih 200 milijonov let nazaj, se je (tudi) po Evropi sprehajala velika žival, ki pa ni bila dinozaver.